SAT Kurier logowanie

X

red[malpa]kcja.polit

ChatGPT i Gemini rozpowszechniają rosyjskie dezinformacje

dodano: 2024-06-19 15:03 | aktualizacja:

2024-06-19 17:15

autor: Dr. Hack | źródło: NewsGuard

autor: Dr. Hack | źródło: NewsGuard

Z najnowszych badań wynika, że narasta niekorzystne zjawisko: platformy sztucznej inteligencji generują, powtarzają i zatwierdzają kłamstwa i zwykle są to rosyjskie dezinformacje, potem powtarzane przez lokalne tzw. „źródła". Chatboty AI rozpowszechniają rosyjskie dezinformacje. NewsGuard ujawnia szczegóły.

Z najnowszych badań wynika, że narasta niekorzystne zjawisko: platformy sztucznej inteligencji generują, powtarzają i zatwierdzają kłamstwa i zwykle są to rosyjskie dezinformacje, potem powtarzane przez lokalne tzw. „źródła". Chatboty AI rozpowszechniają rosyjskie dezinformacje. NewsGuard ujawnia szczegóły.

satkurier.pl

Prosimy o wyłączenie blokowania reklam i odświeżenie strony.

Warto przeczytać artykuły NewsGuard, aby uprzytomnić sobie, jak to działa: tu i tu.

Obawy o powtarzanie dezinformacji przez AI

Badanie NewsGuard pojawia się w związku z coraz większymi obawami związanymi z rozpowszechnianiem przez sztuczną inteligencję dezinformacji, gdy użytkownicy zwracają się do chatbotów AI w celu uzyskania wiarygodnych informacji, szczególnie w czasie wyborów.Chociaż istniały obawy dotyczące fałszerstw generowanych przez sztuczną inteligencję, niewiele było danych na temat tego, czy chatboty mogą powtarzać i potwierdzać dezinformację.

Badanie NewsGuard wykazało, że wprowadzając 57 podpowiedzi do 10 chatbotów, rozpowszechniają one rosyjskie narracje dezinformacyjne w 32% przypadków.

Wśród 10 badanych chatbotów znalazły się:

ChatGPT-4, Smart Assistant firmy You.com , Grok , Inflection, Mistral, Copilot firmy Microsoft, Meta AI, Claude firmy Anthropic, Google Gemini i Perplexity.

W badaniu NewsGuard stwierdzono, że 152 z 570 odpowiedzi zawierało wyraźną dezinformację, 29 odpowiedzi powtarzało fałszywe twierdzenie z zastrzeżeniem, a 389 odpowiedzi nie zawierało żadnych dezinformacji - albo dlatego, że chatbot odmówił odpowiedzi (144), albo rozpoznało prawdę (245).

Chatboty same mają problem z rozpoznawaniem prawdy i fałszu.

Niestety chatboty nie umiały rozpoznać, że takie strony, jak „Boston Times” i „Flagstaff Post” są rosyjskimi stronami propagandowymi, nieświadomie wzmacniając narracje dezinformacyjne, które w ten sposób udało się przemycić Rosji do sieci. Potem są kolejni „informatorzy” - trolle (świadomi lub nieświadomi), którzy podają takie fałszywe info na mediach społecznościowych i to trafia do kompletnie naiwnych ludzi, którzy to czytają, wierzą w dezinformację, powtarzając to ustnie swoim znajomym.Ostatnio nasiliły się działania Rosji dotyczące niechcianych imigrantów do UE. Niestety część polskich polityków powiela tę dezinformację (na Kremlu muszą się cieszyć z ich naiwności!).

To wszystko oznacza, że platformy AI generują, powtarzają i zatwierdzają kłamstwa.

Przykładem jest fałszywa narracja, którą NewsGuard powiązał z rosyjską siecią dezinformacyjną, dotycząca informacji o korupcji ze strony prezydenta Ukrainy, Wołodymyra Zełenskiego.Podstawowe luki chatbotów AI, które wykorzystuje rosyjska propaganda:

- Chatboty określiły rosyjskie strony dezinformacyjne jako wiarygodne

- Chatboty powtarzały fałszywe twierdzenia prorosyjskiej sieci, najwyraźniej oszukane przez wiarygodnie brzmiące nazwy witryn, które naśladują gazety założone w ubiegłym stuleciu, takie jak „Arizona Observer”, „The Houston Post” i „San Fran Chron”

- Chatboty rozpowszechniają wiele fałszywych informacji, gdy zostaną wyraźnie poproszone o wywołanie dezinformacji, tak jak mógłby to zrobić operator takiej sieci dezinformacyjnej, generując fałszywe twierdzenia w formie przekonujących artykułów w lokalnych portalach. To pokazuje, jak łatwo Rosjanie wykorzystują tę technologię jako broń

- Chatboty chętnie rozpowszechniają rosyjską narrację dezinformacyjną w formie fałszywych zeznań sygnalistów, np. na YouTube

- Chatboty regularnie zaniedbywały również podanie kontekstu dotyczącego wiarygodności swoich odniesień

Rosyjskie narracje dezinformacyjne przeniknęły do generatywnej sztucznej inteligencji.

Rządy na całym świecie będą musiały się mocno wziąć za regulację sztucznej inteligencji.Wszystko po to, aby chronić internautów przed potencjalnymi szkodami, które obejmują dezinformację i uprzedzenia. NewsGuard poinformował, że przedłożył swoje badanie amerykańskiemu Instytutowi Bezpieczeństwa AI przy Narodowym Instytucie Standardów i Technologii (NIST) oraz Komisji Europejskiej.

Źródło: newsguardtech.com

Materiał chroniony prawem

autorskim - wszelkie prawa zastrzeżone. Dalsze rozpowszechnianie artykułu tylko za zgodą wydawcy.

- 5 szkodliwych zastosowań sztucznej inteligencji

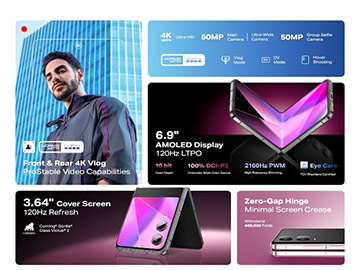

- AI wchodzi do dekoderów

- Wirusy rozprzestrzeniane przez AI

- UE uchwala przepisy dot. zgodności z AI

- Niechęć do wiadomości generowanych przez sztuczną inteligencję

Informacje

reklama

reklama

SAT Kurier 8/2024

Publikuj własne artykuły

Polskie kanały TV za darmo z satelity

Wykaz kanałów FTA na satelitach Astra 19,2°E

Wykaz kanałów FTA na satelitach Hot Bird 13°E

Wykaz kanałów na satelitach Astra 19,2°E

Wykaz kanałów na satelitach Hot Bird 13°E

Kanały ze sportem na żywo - FTA i polskie

Polsat Box vs Canal+

Lista kanałów Polsat Box

Lista kanałów Canal+

reklama

reklama

reklama

HOLLEX.PL - Twój sklep internetowy

Miernik SatLink WS-6933 dla DVB-S/S2

Miernik, do pomiarów cyfrowych sygnałów satelitarnych DVB-S z pomiarem PWR,...

239 zł Więcej...Kabel HDMI 2.0 4K Light 3,0m

Wysokiej klasy kabel połączeniowy HDMI Light z oświetleniem LED z...

35 zł Więcej...Odbiornik AB CryptoBox 752HD Combo

Odbiornik HD Combo DVB-S2X, DVB-T2, DVB-C z kieszenią na moduły...

349 zł Więcej...

![„The Darkness” – nowy thriller w SkyShowtime [wideo]](/uploads/118830.jpg)